马上注册,结交更多好友,享用更多功能^_^

您需要 登录 才可以下载或查看,没有账号?立即注册

x

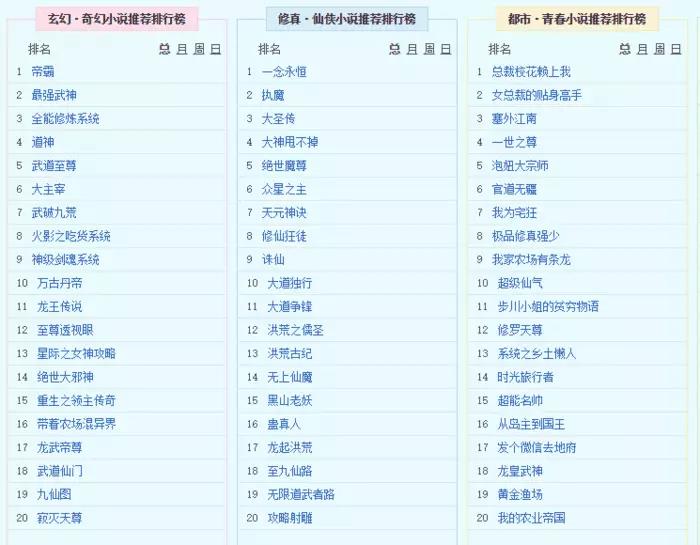

喜欢看小说的骚年们都知道,总是有一些小说让人耳目一新,不管是仙侠还是玄幻,前面更了几十章就成功圈了一大波粉丝,成功攀上飙升榜,热门榜等各种榜,扔几个栗子出来:

新笔趣阁是广大书友最值得收藏的网络小说阅读网,网站收录了当前......我就不打广告了(其他满足下文条件的网站也行,之前已经有做过简单爬取章节的先例了,但效果不太理想,有很多不需要的成分被留下了,来链接:http://www.bxquge.com/。我们本文就爬取这个网站的上千本小说。重点在和大家一起分享一些爬虫的思路和一些很常遇到的坑。

本文的行文脉络:

1、先构造一个单本的小爬虫练练手;

2、简要分享一下安装MongoBD数据库时的几个易错问题;

3、运用Scrapy框架爬取新笔趣阁全站排行榜。

一、爬取单本小说

爬取该网站相对来讲还是很容易的,打开编辑器(推荐使用PyCharm,功能强大),首先引入模块urllib.request(Python2.x的引入urllib和urllib2即可,待会我把2.x的也写出来给大家看看),给出网站URL,写下请求,再添加请求头(虽然这个网站不封号,但作者建议还是要养成每次都写请求头的习惯,万一那天碰到像豆瓣似的网站,一不留神就把你封了)话不多说,直接上代码: - #coding:utf-8

- import urllib.request

- url = "http://www.bxquge.com/3_3619/10826.html"

- headers = {'User-Agent':

- 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36

- (KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36 Edge/15.15063'}

- request = urllib.request.Request(url,headers=headers)

然后再将请求发送出去,定义变量response,用read()方法观察,注意将符号解码成utf-8的形式,省的乱码:- #coding:utf-8

- import urllib.request

- url = "http://www.bxquge.com/3_3619/10826.html"

- headers = {'User-Agent':

- 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36

- (KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36 Edge/15.15063'}

- request = urllib.request.Request(url,headers=headers)

- response = urllib.request.urlopen(request)

- html = response.read()

- html = html.decode("utf-8")

- print(html)

打印一下看结果:

看到这么一大条就对喽,对比一下网页源码,发现是一致的。

这步观察很重要,因为这就说明该网站没有使用AJAX异步加载,否则就要开始抓包的工作了,这个我们留着分析动态网站时候再说。建议大家在没有更好的方法时使用。之前记得确实有直接判断的方法,然而一不小心忘记了,有知道的读者还请发给我哦。

我们现在得到了网站的response,接下来就是对我们想要获取的数据进行解析、提取,但等等,考虑到我们要爬取大量小说,不搞一个数据库存储真是太失败了,作者推荐MongoDB数据库,属于NOSQL类型数据库,以文档存储为主,这里用来爬小说真是太适合不过了。但安装起来需要一定的程序,想要试着做做的骚年可以参考一下下载和安装教程,参考链接:http://blog.csdn.net/u011262253/article/details/74858211,在安装好后为方便启动,可以添加环境变量,但这里有个坑,你要先打开mongod(注意是mongodb,别一上来就打开mongo),然后需要准确添加dbpath路径,不然打开很容易就会失败,上图上图:

失败状态

成功状态

添加路径后成功连接,出现waiting for connections on port 27017,则表示数据库连接成功,而后就不要关掉这个终端了,只有保持数据库是连接的,才可运行MongoDB数据库(不然报错你都不知道自己是怎么死的)

好了,连接好数据库后,我们将数据库与编辑器进行交互链接,位置很隐秘,在File>>Settings>>Plugins下添加组件Mongo Plugin,没有就下载一个:

盗个图

我们在编辑器内编写代码,引入Python专门用来与MongoDB交互的模块pymongo,然后在最上面链接MongoDB数据库的端口,默认是27017,我们先创建一个叫做reading的数据库,然后在reading内新建一个叫做sheet_words的数据表,代码如下:

- #coding:utf-8

- import pymongo

- import urllib.request

- client = pymongo.MongoClient('localhost',27017)

- reading = client['reading']

- sheet_words = reading['sheet_words']

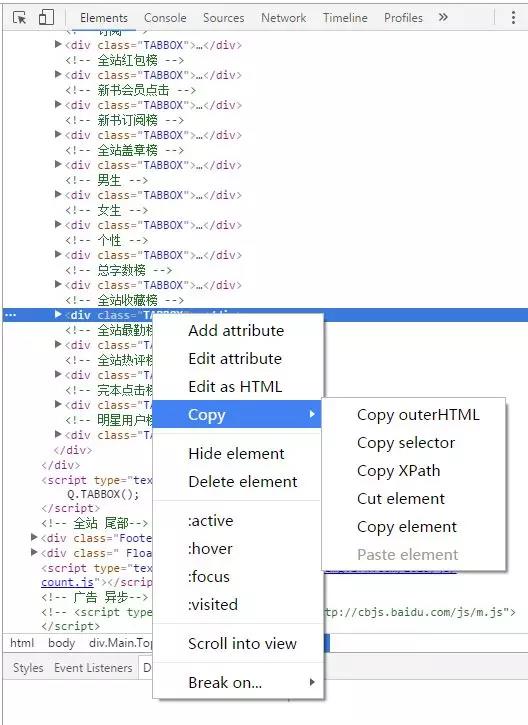

我们先找一个叫做《修罗武神》的小说来练练手,个人来讲,我很讨厌看小说时来回的翻页,有时候还跳出广告,这时候我还得返回去重新翻页,作为一名懒得不行的懒人,我想到要是把整部小说放进一个文档里再看不就好了么,但要是一章一章的复制粘贴我想还是算了吧,这时候你就知道爬虫是有多么便捷了。好,现在我们要做的是把《修罗武神》这部小说完整的爬取下来,并在数据库中备份。我们回到刚才停留的地方,在得到response后,我们应该选用一种方法来解析网页,一般的方法有re,xpath,selector(css),建议新手使用xpath而不是re,一是因为re用不好很容易导致错误,“当你决定用正则表达式解决问题时,你有了两个问题。”,相比较xpath才是步骤明确,十分稳妥;二是在Firefox,Chrome等浏览器中可以直接复制xpath路径,大大的减少了我们的工作量,上图:

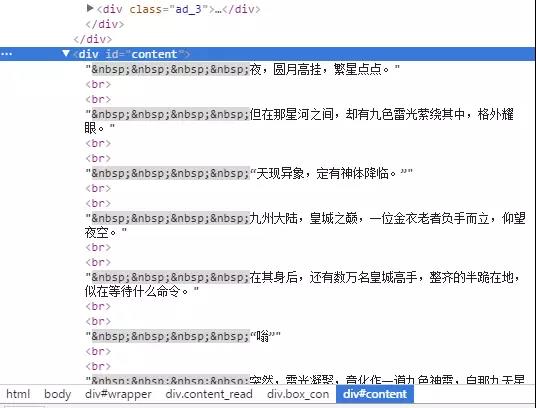

如果你决定使用xpath之后,我们需要从lxml中引入etree模块,然后就可以用etree中的HTML()方法来解析网页了,从网页>检察元素(F12)中复制下来我们所需数据的路径,我选择的是小说每章的标题和内容,上图,上图:

路径//div[@class="readAreaBox content"]/h1/text()

路径/html/body/div[4]/div[2]/div[2]/div[1]/div[2]/text()

注意注意,又来一个坑,当你复制xpath时得到的是这个东东:

//div[@class="readAreaBox content"]/h1

和这个东东;

/html/body/div[4]/div[2]/div[2]/div[1]/div[2]

但你需要的是这个路径里的文本text,故我们需要另外添加具体文本:/text(),然后就像上面那样啦。上代码,查数据: - url = 'http://www.17k.com/list/493239.html'

- response = urllib.request.urlopen(url)

- html = response.read().decode("utf-8")

- tree = etree.HTML(html)

- dom = tree.xpath('//a[@target="_blank"][@title]/@href')

- for i in dom:

- data = {

- 'words':"http://www.17k.com" + i

- }

- sheet_words.insert_one(data)

- # $lt/$lte/$gt/$gte/$ne,依次等价于</<=/>/>=/!=。(l表示less g表示greater e表示equal n表示not )

- try:

- os.mkdir("修罗武神小说")

- except FileExistsError:

- pass

- os.chdir("修罗武神小说")

- for item in sheet_words.find():

- filename = "修罗武神"

- with open( filename,"a+") as f:

- contents = urllib.request.urlopen(item["words"])

- responses = contents.read().decode("utf-8")

- trees = etree.HTML(responses)

- title = trees.xpath('//div[@class="readAreaBox content"]/h1/text()')

- word = trees.xpath("/html/body/div[4]/div[2]/div[2]/div[1]/div[2]/text()")

- a = ''.join(title)

- b = ''.join(word)

- f.write(a)

- f.write(b)

- #print(''.join(title))

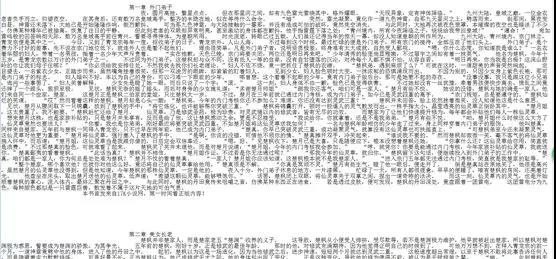

小说文本

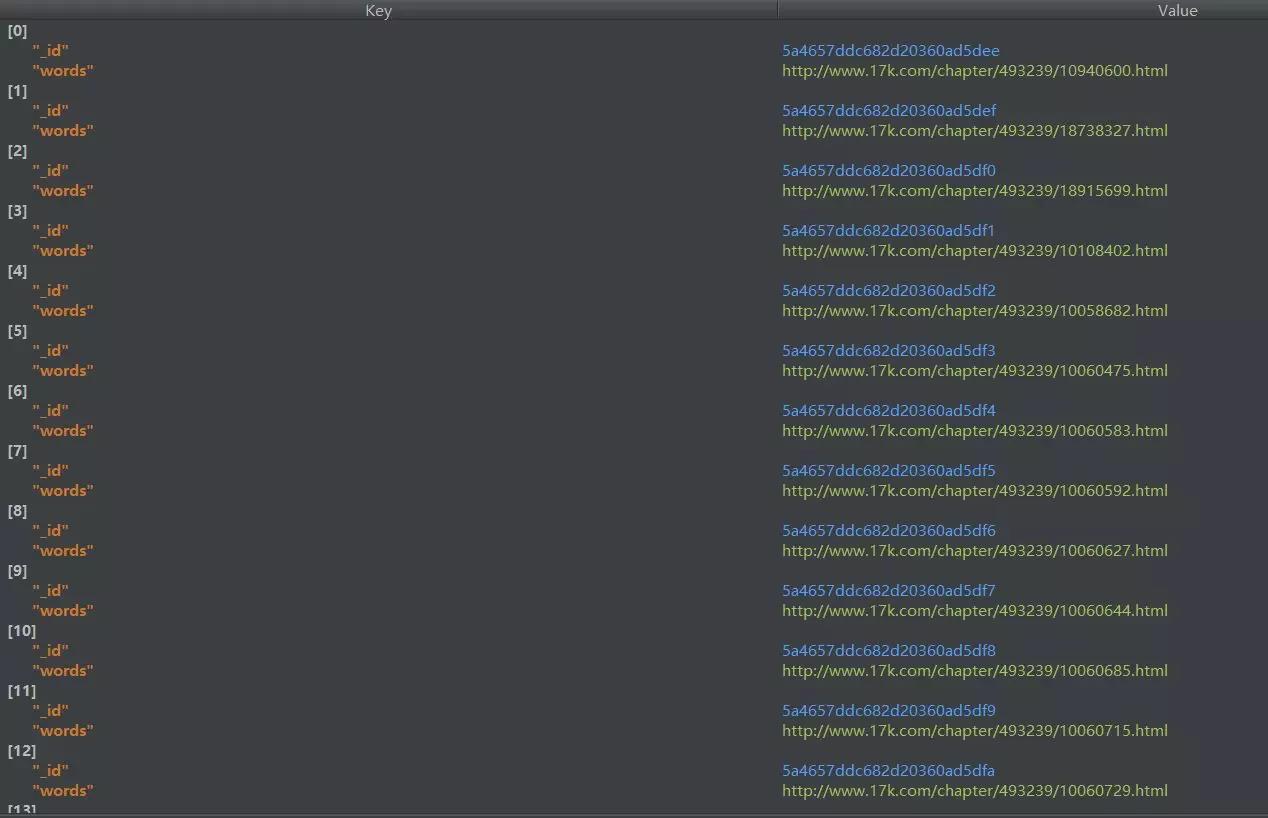

数据库连接

看看,感觉还不错吧,好的小例子讲完了,接下来我们准备进入正题。

我们要像上面的例子那样爬取整个网站,当然这里就不再建议使用普通的编辑器来来执行了,聪明的读者已经发现,一部小说爬了4分钟,那么上千本不说,单单是一组排行榜里的100本就够爬好一会了,这就显示出Scripy框架的作用,用专门的Scripy框架写工程类爬虫绝对快速省力,是居家写虫的必备良药哇。

二、爬取小说榜所有小说

然后还是老规矩,不想每次终端运行都一点一点找路径的话,就将根目录添加到环境变量,然后打开终端,我们测试一下是否安装成功: Scrapy安装成功

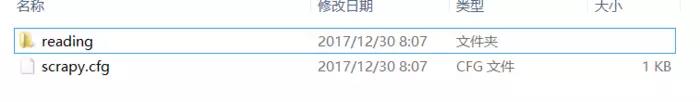

好,安装完毕后,打开终端,新建一个Scrapy工程,这里你可以根据索引,选择使用Scrapy的各种功能,这里不一一详解了,D盘内已经出现了我们建立好的Scrapy工程文件夹:

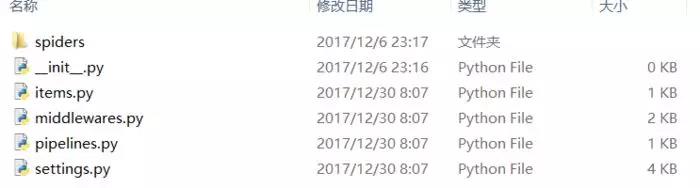

打开文件夹,我们会看到Scrapy框架已经自动在reading文件夹中放置了我们所需的一切原材料:

打开内部reading文件夹,就可以在spiders文件夹中添加爬虫py代码文件了:

我们这里定向爬小说排行榜,除了我们写的spider文件,还要在items.py中定义我们要爬取的内容集,有点像词典一样,名字可以随便取,但已有的继承类scrapy.Item可不能改,这是Scrapy内部自定义的类,改了它可找不到,spider就用我们上面抓取单本再加一个for循环就OK了,十分简单,一言不合就上图:

- # -*- coding: utf-8 -*-

- import scrapy

- import urllib2

- from lxml import etree

- import os

- from reading.items import ReadingSpiderItem

- import sys

- reload(sys)

- sys.setdefaultencoding('utf-8')

- class ReadingspiderSpider(scrapy.Spider):

- name = 'bigreadingSpider'#爬虫名

- allowed_domains = ['http://www.xinbiquge.com/']#总域

- start_urls = ['http://www.bxquge.com/paihangbang/']#起始页

- def parse(self, response):

- sel = scrapy.selector.Selector(response)#解析域

- for i in range(2,10):

- path = '//*[@id="main"]/table[' +str(i)+ ']/tbody/tr[1]/td[2]/span'#排行榜路径

- sites = sel.xpath(path)

- items = []

- for site in sites:#按9个排行榜爬取

- item = ReadingSpiderItem()

- path_list_name = '//*[@id="main"]/table[' +str(i)+ ']/tbody/tr[1]/td[2]/span/text()'

- item['list_name'] = site.xpath(path_list_name).extract()#排行榜名称

- try:

- os.mkdir(item['list_name'][0])

- except IOError:

- pass

- os.chdir(item['list_name'][0])

- for li in range(1,21):

- title = '//*[@id="tb' + str(i-1) + '-1"]/ul/li['+str(li)+']/a/text()'

- item['name'] = site.xpath(title).extract()#书名

- url = 'http://www.bxquge.com/'

- path_link = '//*[@id="tb'+ str(i-1) +'-1"]/ul/li[' + str(li) + ']/a/@href'#书目链接

- item['link'] = site.xpath(path_link).extract()

- full_url = url + item['link'][0]

- headers = {'User-Agent':

- 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36

- (KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36 Edge/15.15063'}

- #request = urllib2.Request(''.join(item['link']),headers=headers)

- request = urllib2.Request(full_url,headers=headers)

- try:

- os.mkdir(item['name'][0])

- except IOError:

- pass

- os.chdir(item['name'][0])

- response = urllib2.urlopen(request).read().decode('utf-8')

- tree = etree.HTML(response)

- for j in range(1,11):

- path_title = '//*[@id="list"]/dl/dd['+ str(j) +']/a/text()'

- item['title'] = tree.xpath(path_title)#章节名

- path_words_page = '//*[@id="list"]/dl/dd['+ str(j) +']/a/@href'

- word_page = tree.xpath(path_words_page)

- try:

- url_words = full_url + word_page[0]

- request_words = urllib2.Request(url_words,headers=headers)

- response_words = urllib2.urlopen(request_words).read().decode('utf-8')

- tree_words = etree.HTML(response_words)

- path_words = '//*[@id="content"]/text()'

- item['words'] = tree_words.xpath(path_words)#前20章内容

- except urllib2.HTTPError:

- pass

- items.append(item)

- try:

- filename = r''.join(item['title'][0]) + '.json'

- with open(filename,"a+") as f:

- a = ''.join(item['title'])

- b = ''.join(item['words'])

- f.write(a)

- f.write(b)

- except IOError:

- pass

- path_now = os.getcwd()

- path_last = os.path.dirname(path_now)

- os.chdir(path_last)

- path_now = os.getcwd()

- path_last = os.path.dirname(path_now)

- os.chdir(path_last)

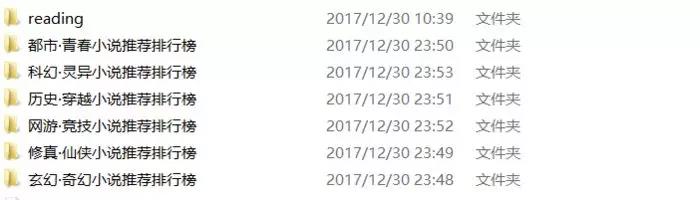

爬取的小说排行榜

每个排行榜上大约20本小说

每部小说的爬取情况(用的是.json格式)

小说显示内容

至此,我们所需的数据就都爬取完了,它们都按照相应的文件夹目录放置好在相应位置,适合条理性的观看。 全部代码可以在回复后查看。对于本文内容若有更好的提议、手法,望各位读者大大们留言。 (完)

|  ( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)