|

|

马上注册,结交更多好友,享用更多功能^_^

您需要 登录 才可以下载或查看,没有账号?立即注册

x

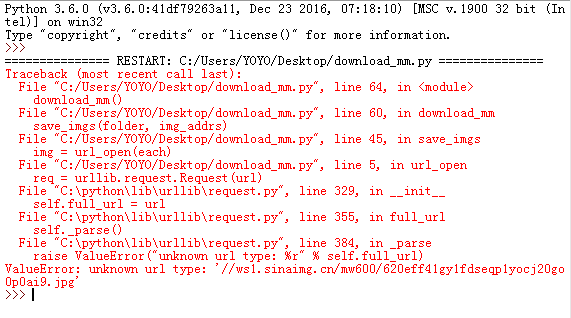

跟随小甲鱼老师的视频,

在使用代理之前,

全程按照老师的代码写,

结果跑起来还是报错,

求牛人指点,

谢谢!

代码如下:

import urllib.request

import os

def url_open(url):

req = urllib.request.Request(url)

req.add_header('User-Agent', 'Mozilla/5.0 (Windows NT 6.1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36')

response = urllib.request.urlopen(url)

html = response.read()

return html

def get_page(url):

html = url_open(url).decode('utf-8')

a = html.find('current-comment-page') + 23

b = html.find(']', a)

return html[a:b]

def find_imgs(url):

html = url_open(url).decode('utf-8')

img_addrs = []

a = html.find('img src=')

while a != -1:

b = html.find('.jpg', a, a+255)

if b != -1:

img_addrs.append(html[a+9:b+4])

else:

b = a + 9

a = html.find('img src=', b)

return img_addrs

def save_imgs(folder, img_addrs):

for each in img_addrs:

filename = each.split('/')[-1]

with open(filename, 'wb') as f:

img = url_open(each)

f.write(img)

def download_mm(folder='ooxx', pages=10):

os.mkdir(folder)

os.chdir(folder)

url = "http://jandan.net/ooxx/"

page_num = int(get_page(url))

for i in range(pages):

page_num -= i

page_url = url + 'page-' + str(page_num) + '#comments'

img_addrs = find_imgs(page_url)

save_imgs(folder, img_addrs)

if __name__ == '__main__':

download_mm()

根据你的错误,你的图片的地址不对,我去煎蛋网上审查元素发现获取回来的图片地址都少了http:开头,在每次下载图片之前加上http:就可以了

你要尝试自己调试下,除了自己去网站审查元素

还有一个方法就是你觉得可能出错的地方或者变量加上print语句

- def save_imgs(folder, img_addrs):

- for each in img_addrs:

- each = 'http:' + each

- filename = each.split('/')[-1]

- with open(filename, 'wb') as f:

- img = url_open(each)

- f.write(img)

附上我修改的部分,可以下载,不过我没有全爬,估计还有其他问题,因为看到一些图片的地址不对

|

-

|

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)

( 粤ICP备18085999号-1 | 粤公网安备 44051102000585号)